Evolución del Deepfake: campos semánticos y géneros discursivos (2017-2021)

Jabob Bañuelos

Evolución del Deepfake: campos semánticos y géneros discursivos (2017-2021)

ICONO 14, Revista de comunicación y tecnologías emergentes, vol. 20, núm. 1, 2022

Asociación científica ICONO 14

Evolution of Deepfake: semantic fields and discursive genres (2017-2021)

Evolução do Deepfake: campos semânticos e gêneros discursivos (2017-2021)

Jabob Bañuelos Capistrán  1 jcapis@tec.mx

1 jcapis@tec.mx

Departamento de Medios y Cultura Digital del Tecnológico de Monterrey, México

Recibido: 01 julio 2021

Revisado: 06 agosto 2021

Aceptado: 17 febrero 2022

Publicado: 13 abril 2022

Resumen: El presente estudio tiene como finalidad realizar un análisis de la evolución de los campos semánticos y géneros discursivos del deepfake desde su aparición en 2017 y hasta 2021. La investigación tiene como fundamento una revisión bibliográfica de artículos especializados de divulgación, informativos, teóricos y científicos sobre deepfake, con base en una metodología longitudinal analítica-sintética en tres fases entre 2017-2021, en donde se aplica la valoración narrativa de la Escala SANRA. El estudio identifica los campos semánticos y géneros discursivos dominantes del deepfake, así como la evolución de su usos benéficos y delictivos. El estudio revela una progresiva evolución discursiva en donde emergen nuevos campos semánticos y géneros discursivos del deepfake, con una tendencia hacia usos benéficos y no sólo delictivos en la esfera de la industria audiovisual, el activismo, el arte experimental, los usos comerciales, médicos, la publicidad, la propaganda y la educación, entre otros.

Palabras clave: Deepfake; campos semánticos; géneros discursivos; comunicación; evolución.

Abstract: The present study aims to carry out an analysis of the evolution of the semantic fields and discursive genres of deepfake since its appearance in 2017 and until 2021. The research is based on a bibliographic review of specialized dissemination, informative, theoretical, and scientific articles on deepfake, based on a longitudinal analytical-synthetic methodology in three phases between 2017-2021, where the narrative assessment of the SANRA Scale is applied. The study identifies the dominant semantic fields and discursive genres of deepfake, as well as the evolution of its beneficial and criminal uses. The study reveals a progressive discursive evolution in which new semantic fields and discursive genres of deepfake emerge, with a tendency towards beneficial uses and not only criminal ones in the sphere of the audiovisual industry, activism, experimental art, commercial uses, medical, advertising, propaganda, and education, among others.

Keywords: Deepfake; semantic fields; discourse genres; communication; evolution.

Resumo: O presente estudo tem como objetivo realizar uma análise da evolução dos campos semânticos e gêneros discursivos do deepfake desde o seu surgimento em 2017 e até 2021. A pesquisa se baseia em uma revisão bibliográfica de artigos de divulgação especializada, informativos, teóricos e científicos sobre deepfake, com base numa metodologia analítico-sintética longitudinal em três fases entre 2017-2021, onde é aplicada a avaliação narrativa da Escala SANRA. O estudo identifica os campos semânticos dominantes e os gêneros discursivos do deepfake, bem como a evolução de seus usos benéficos e criminosos. O estudo revela uma evolução discursiva progressiva em que novos campos semânticos e gêneros discursivos de deepfake emergem, com tendência a usos benéficos e não apenas criminosos na esfera da indústria audiovisual, ativismo, arte experimental, usos comerciais, médicos, publicitários, propaganda e educação, entre outros.

Palavras-chave: Deepfake; campos semânticos; gêneros do discurso; comunicação; evolução.

Introducción

El presente estudio tiene como finalidad realizar un análisis de la evolución de los campos semánticos y los géneros discursivos del deepfake desde su aparición en 2017 y hasta 2021. El escenario de los campos semánticos y géneros discursivos del deepfake ha ido evolucionando de manera rápida y dinámica desde su primera aparición en 2017 en Reddit (Ajder et al., 2019). Se trata de una especie mediática emergente, que impacta en un escenario más grande, conformado por la industria y el consumo de la cultura audiovisual.

El deepfake se nutre de la evolución tecnológica de producción de imágenes y sonidos mediante inteligencia artificial (IA), de los contenidos publicados en redes sociales y plataformas digitales, de grandes bases de datos (big data), de la memoria audiovisual colectiva y de la arquitectura sociomediática de la posverdad.

La evolución del deepfake presenta una expansión y dispersión discursiva en donde encontramos campos semánticos, géneros discursivos, y tecnologías emergentes en los que se producen contenidos tanto benéficos como delictivos. Las formas de expresión benéficas del deepfake aportan nuevas formas de expresión audiovisual que contribuyen al desarrollo educativo, la medicina y la salud, la ciencia, el comercio, la moda, el comercio electrónico, la publicidad, la seguridad, el entretenimiento, la reflexión social, política, artística y cultural.

El estudio tiene como base la teoría tecno-éstética (Simondon, 2013), los campos semánticos (Lewandowski, 1982), la teoría del discurso (Van Dijk, 1989) y la teoría de la posverdad (Ball, 2017; Ibañez, 2017; Amorós, 2018; McIntyre, 2018; Kalpokas, 2019; Cosentino, 2020), desde la que se analizan los campos semánticos del deepfake y géneros discursivos emergentes que componen, en su conjunto, un escenario industrial y cultural expandido del deepfake.

Técnicamente, los deepfakes son producto de la IA y la técnica de "aprendizaje profundo" (deep learning) aplicados para entrenar redes neuronales. Estas redes neuronales profundas pueden generar y manipular videos, imágenes y audio de manera artificial. Mediante este sistema es posible crear de manera automática contenidos hiperrealistas falsos, que pueden parecer realistas e interpretarse como ciertos o verdaderos (Kietzmann et al., 2020, p. 136).

Mediante un deepfake resulta prácticamente imposible saber si la imagen o la voz de una persona es falsa o verdadera, o si la autenticidad de una fotografía, un sonido o un documento audiovisual se encuentra bajo sospecha de haber sido manipulada o creada artificialmente (Kietzmann et al., 2020). Un deepfake es un producto que combina, superpone, fusiona o reemplaza varios tipos de contenido para producir medios sintéticos con IA y aprendizaje profundo, lo cual ensombrece la noción de autenticidad (Maras y Alexandrou, 2018; Nguyen, 2019).

El deepfake, entendido como objeto técnico-cultural, se analiza desde la teoría tecno-estética de Simondon (2013). Un objeto técnico es conformado por una “capa interna” (técnica, estética y cultural), una “capa intermediaria” (mediación tecnológica) y una “capa exterior” (manifestaciones, usos y prácticas culturales) (Simondon, 2013). En este estudio nos centramos en la exploración y análisis de la “capa exterior” del deepfake como objeto técnico y cultural, en la descripción de los campos semánticos, los géneros discursivos y las aplicaciones tecnológicas emergentes, así como de los usos benéficos como delictivos más comunes.

El conocimiento, conceptualización y práctica tecnológica, social, política, comunicacional, estética, industrial y legal de los deepfakes ha dado lugar al desarrollo de diversos campos semánticos (Lewandowski, 1982, p. 46), que articulan terminología especializada, pactos de lectura, codificación y sentido interpretativo a partir de territorios conceptuales, motivaciones y formas de operación diversas.

Los campos semánticos son entendidos como grupos que forman unidades de significación y que están constituidos por conjuntos de palabras con contenidos objetivos interrelacionados (Ipsen, 1924; Lewandowski, 1982, p. 47). Como un conjunto de relaciones formales y de sentido que conlleva un grupo de palabras, y como conjunto de hechos coexistentes que se interpretan como dependientes entre sí (Lewandowski, 1982, p. 44-46). Un campo semántico es el conjunto de términos cuyo significado se refiere a un concepto común (Martínez, 2003).

Discursivamente, un deepfake es un producto sonoro, visual o audiovisual que simula las características formales de algún género de expresión previo, que retoma las claves de su tratamiento de contenido para hacerlo parecer auténtico, con una atribución de sentido, siendo artificialmente construido o falso.

Un género discursivo es entendido como una forma específica del uso del lenguaje, texto, sonido, imagen, un evento comunicativo completo en una situación social determinada. El significado del discurso, de un deepfake en este caso, es una estructura cognitiva. Es necesario incluir elementos observables verbales y no verbales, interacciones sociales y actos de habla, y además las representaciones cognitivas y estrategias involucradas durante la producción o comprensión del discurso (Van Dijk, 1989).

Los géneros discursivos del deepfake existen en la sociedad como una forma de práctica social y producen interacciones entre individuos y grupos sociales. De acuerdo con Van Dijk (1993), los estudios sobre el discurso, en este caso del deepfake, deben profundizarse explicando qué atributos del texto sonoro, visual y audiovisual determinan qué atributos de las estructuras sociales, políticas y culturales, y viceversa, de acuerdo con Van Dijk (citado en Meersohn, 2021).

La vida digital del deepfake transcurre en un escenario sociomediático marcado por el fenómeno de la posverdad (Ball, 2017; Ibañez, 2017; D´Ancona, 2018), campo fértil para la proliferación de los discursos de la simulación y la falsificación, así como por un cuestionamiento crítico de los discursos del hacer creer, como el periodismo, la ciencia, la religión, la política y los sistemas de información.

Método

El estudio se conforma de tres fases de investigación, diacrónicas y consecutivas, realizadas (entre el 1 y el 15 de junio de 2021) para el período 2017–2021.

-

Una exploración bibliográfica bajo una metodología longitudinal analítica-sintética (Rodríguez Jímenez y Pérez-Jacinto, 2017) a través del buscador Google Search, que permitió explorar los orígenes, casos y definiciones del deepfake, mediante artículos periodísticos, informes y textos especializados.

-

Una exploración siguiendo la metodología de investigación bibliográfica, que describen Codina (2018), Piasecki et al. (2018) y De-Granda-Orive et al. (2013), mediante motores de búsqueda para textos académicos y científicos.

-

Una exploración sobre el desarrollo de aplicaciones y los procesos tecnológicos de manipulación de imágenes y sonidos, especialmente centrado en apps para dispositivos móviles, como parte de la evolución de las shallowfakes (o cheapfakes). En total se revisaron 65 publicaciones, que fueron analizadas y valoradas mediante la Escala SANRA - Scale for the Assessment of Narrative Review Articles (Baethge et al., 2019).

El promedio de la valoración de calidad argumentativa y narrativa de los artículos analizados mediante la escala SANRA fue de 10.3. La evaluación máxima en esta escala es de 12, así que la calidad argumentativa y narrativa de los artículos es alta de acuerdo con esta escala. También, la catalogación realizada sobre los campos semánticos y géneros discursivos del deepfake, recupera la valoración mediante la escala SANRA, que contribuyó a dar mayor claridad y fundamento, además de las búsquedas hechas en las bases de datos científicas citadas. Las 65 publicaciones revisadas y analizadas se citan en este texto (Bañuelos, 2022).

La búsqueda del término “deepfake” en todas las bases de datos se realizó sobre todos los campos de búsqueda (título, tópico, palabras clave, resumen, etc.). La búsqueda realizada en la base de datos de Web of Science Core Collection no incluyó las bases de datos de Medline, KCI-Korean Journal Database, Russian Science Citation Index, SciELO Citation Index. Las palabras “deepfake” and “discourse” se buscaron en todos los campos (título, tópico, resumen, etc.).

La exploración se ha orientado a la información relacionada con Ciencias Sociales, Comunicación, Legislación, Ética, Entretenimiento y Comunicación. Además, se emplearon las palabras clave “deepfake”, “deepfake” and “discourse”, “deepfake” and “augmented reality”, “deepfake” and “ethics”, “deepfake” and “apps”, “deepfake” and “porn”. Igualmente, se incluyeron búsquedas y artículos tanto en español como en inglés. Así, una vez encontrado un artículo se realizó una búsqueda similar para encontrar más artículos sobre una fuente particular, en la búsqueda relacionados con noticias, negocios, medios, desinformación, entretenimiento o tecnología.

En la búsqueda analítica-sintética longitudinal se consultaron artículos de divulgación, informes y revistas como MIT Technology Review, Deeptrace (Ajder et al., 2019, Ajder et al., 2020), Motherboard (Vice), The New York Times, Washington Post, The Guardian, The Economist, The Times . The BBC. Para la exploración de artículos académicos y científicos se emplaron las bases de datos de Scopus, Web of Science, Taylor and Francis Journals, Google Scholar, Academy y Research Gate; y para la búsqueda transversal de aplicaciones y desarrollos tecnológicos del deepfake se consultaron fuentes especializadas como Nguyen et al. (2019); Chen et al. (2020); Paris y Donovan, (2019), Westerlund, (2019) y Gómez-de-Ágreda et al., (2021).

Resultados

Campos semánticos del deepfake

Los campos semánticos del deepfake se han fortalecido y expandido. El análisis bibliográfico realizado en la búsqueda de la palabra deepfake en bases de datos científicas demuestra que los campos semánticos relevantes y más fortalecidos pertenecen a las Ciencias Computacionales, la Ingeniería y las Matemáticas. Sin embargo, los campos semánticos relacionados con las Ciencias Sociales y las Humanidades, aunque están en segundo plano, han aumentado progresivamente en áreas como el derecho, ética, comunicación, desinformación, pornografía, publicidad y seguridad (Ver figura 1).

Es significativo el caso de Scopus, en donde aparecen 603 artículos sobre deepfake entre 2018 y 2021, de los cuales 447 están relacionados con el campo de las Ciencias Computacionales, 224 con Ingeniería, 166 con Ciencias Sociales, 74 con Matemáticas, 68 con Ciencias para la Toma de Decisiones, 39 con Arte y Humanidades, 36 con Material Científico, 31 con Física y Astronomía, 29 con Psicología y 24 con Negocios, Gestión y Contabilidad. Como se puede observar, el campo de investigación sobre deepfake está mucho más desarrollado en el área de Ciencias Computacionales e Ingeniería, respecto a Ciencias Sociales y Humanidades..

Del mismo modo, destaca que para la búsqueda “deepfake” and “discourse” en la base de datos de Scopus aparecen únicamente 48 documentos publicados entre 2018 y 2021, de los cuales 37 están relacionados con Ciencias Sociales, 13 con Ciencias Computacionales, 12 con Artes y Humanidades, 5 con Psicología y 4 con Negocios. Los artículos relacionados con Ciencias Sociales tratan diversos temas, regulación, delitos sexuales, discriminación a la mujer, pornografía, política, desinformación, regulación social, construcción social de la tecnología, seguridad, ciber-ética, racismo, publicidad y ciencia ficción.

En las áreas de Ciencias Sociales y Humanidades destacan los campos de comunicación, desinformación, periodismo, medios electrónicos, medios digitales, plataformas y redes sociodigitales, industria fílmica, ciencia ficción, educación, arte, juegos y entretenimiento, legislación y regulación social, ética, ciber-ética, pornografía, ciber-acoso, política, publicidad, marketing, negocios, comercio electrónico y moda. Y en el campo de la salud, destacan psicología y material científico.

En los campos semánticos pioneros del deepfake se ha desarrollado una industria delictiva dedicada a la producción de prácticas de desinformación, pornografía, fake news y su detección (Fraga-Lamas et al., 2020; Güera y Delp, 2018; Sohrawardi et al., 2019; Maras y Alexandrou, 2018; Cerdán et al., 2020; Xu et al., 2021; Adriani, 2019; Cooke, 2018), bots, falsificación, extorsión, suplantación de identidades, difamación, acoso y ciberterrorismo (Gosse y Burkell, 2020; Westerlund, 2019; Vaccari y Chadwick, 2020; Gómez-de-Ágreda et al., 2021; Temir, 2020, Ajder et al., 2020; Barnes y Barraclough, 2019).

Simultáneamente, emergen campos semánticos del deepfake que configuran una poderosa industria audiovisual que abarca un desarrollo tecnológico orientado a la producción, la detección, la ciberseguridad, la comercialización de software especializado y aplicaciones móviles. Aunado a una vigorosa industria del entretenimiento, a través de la producción fílmica, video juegos, aplicaciones en redes sociales, desarrollo de negocios, marketing, turismo, asistentes inteligentes, aplicaciones para el cuidado de la salud y la ciencia (Westerlund, 2019).

Figura 1

Campos semánticos del deepfake 2017-2021

Fuente: Elaboración propia, 2021.

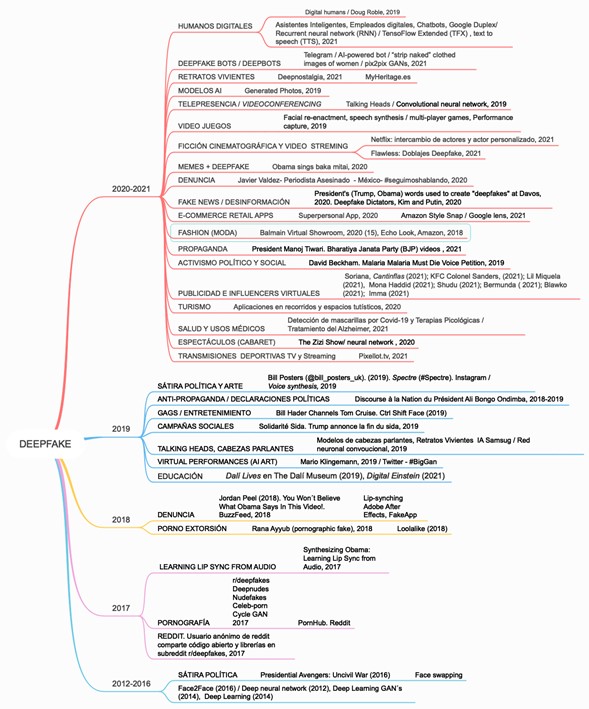

Géneros discursivos del deepfake

Como hemos apuntado, los géneros discursivos adquieren características propias sobre algún campo temático o formal, y son formas de expresión compartidas que producen interacciones entre individuos y grupos sociales, de acuerdo con Van Dijk (citado en Meersohn, 2021). Los géneros discursivos revisados en este estudio son considerados como la “capa exterior” (Simondon, 2013) del deepfake, como manifestaciones, en usos y prácticas culturales de un objeto técnico-estético y cultural, que se experimentan en escenarios digitales dinámicos, progresivos, expansivos y cambiantes.

La catalogación de los géneros discursivos y el mapa de géneros discursivos del deepfake 2017-2021 (Figura 2) que aquí realizamos, tiene como base la investigación documental previamente descrita en la metodología y da cuenta de los casos más significativos. Los criterios de relevancia que se han aplicado para la selección de los casos de géneros discursivos del deepfake incluidos en esta catalogación son: importancia histórica, aparición en diversas publicaciones, originalidad y diversificación hacia nuevas aplicaciones no delictivas.

Se observa que los géneros discursivos más relevantes, que aparecen desde el origen del deepfake entre 2017 y hasta 2019, son: pornografía no consensuada, porno-extorsión, denuncia, virtual perfomances (performances virtuales), retratos vivientes, campañas sociales, parodias de entretenimiento, anti-propaganda, declaraciones políticas, sátira política y arte (Westerlund, 2019; Campbell et al., 2021; Kwok y Koh, 2020; Whittaker et al., 2021; Gómez-de-Ágreda et al., 2021; Initiative, 2020).

Entre 2019-2021 se advierte una emergencia significativa en géneros discursivos benéficos del deepfake como: transmisiones deportivas (AI-automated video), espectáculos, educación, modelos de cabezas parlantes, retratos (deepnostalgia), campañas sociales, activismo social y político, salud y usos médicos, turismo, publicidad, propaganda, moda (virtual showroom, Amazon Syle Snap, Google lens), comercio electrónico (e-commerce, retail apps), asistentes inteligentes, cine y video streaming, video juegos, telepresencia, modelos IA (Generated Photos), humanos digitales (digital humans), video conferencias (videoconferencing), telepresencia, multi-player games, memes, experimentación artística, denuncia, chat virtual, chat bots, avatares personales, terapia psicológica y material científico; y sobre usos delictivos como: fake news, desinformación, pornografía, ciber-acoso, deepfake bots .deepbots) (Westerlund, 2019; Campbell et al., 2021; Kwok y Koh, 2020; Whittaker et al., 2021; Garimella y Eckles, 2020; Oliveira-Teixeira et al., 2021; Gómez-de-Ágreda et al., 2021).

Como muestra la figura 2 los géneros discursivos han experimentado una expansión y una diversificación relevante entre 2012-2021, y se observa una mayor proliferación de géneros discursivos con usos benéficos a partir de 2019.

Algunos géneros son transversales en el tiempo y evolucionan junto con las técnicas del deepfake como la pornografía que, además de ser un género discursivo inicial, también se ha convertido en un amplio campo semántico en el que se debaten problemáticas de tipo legal, ético, regulatorio y sobre todo, en cómo el deepfake pornográfico ha afectado principalmente a las mujeres en el mundo (Martínez et al., 2019; Cole, 2019). Un ejemplo de esta evolución discursiva, tecnológica y estratégica del deepfake pornográfico es el caso de los chatbots de Telegram (Ajder et al., 2020).

Figura 2

Mapa de géneros discursivos del deepfake, 2017-2021

Fuente: Elaboración propia, 2021.

Entre 2012-2016 se encuentran las técnicas incipientes y fundacionales del deepfake como Deep neural network (2012), Deep Learning GAN´s (2014), Deep Learning (2014) y Face2Face (2016). Hacia 2016 encontramos un primer incipiente género de sátira política en Presidencial Avengers: Uncivil War (Parkinson, 2016), producido mediante Face Swapping (Paris y Donovan, 2019, p. 11).

En 2017 comienza la expansión del deepfake, gracias al usuario “deepfakes” desde el r/deepfakes en Reddit en el que compartía videos pornográficos donde insertaba rostros de actrices célebres en cuerpos de actrices porno. Del mismo modo, compartió un código abierto para deep learning en bibliotecas populares y así comenzaron a proliferar deepnudes de manera ilegal en diversos sitios. Esto originó un estallido de sitios porno especializados en deepnudes .nudefakes, y la emergencia de un género denominado celeb-porn en sitios como PornHub (sitio donde se prohibieron los deepfakes pornográficos en 2018) y Mr. Deepfakes (espacio en donde se siguen publicando).

La evolución del deepfake porno llega hasta 2021 con canales de chatbots .deepbots de Telegram que “desnudan” a una mujer a partir de una foto, siguiendo los pasos de la aplicación DeepNude, cerrada en 2019. Una práctica que algunos autores han denominado Automate abuse image (Abuso automatizado de imagen) y que afectó a más de 100 mil mujeres en 2020 (Ajder et al., 2020; Hao, 2020).

En 2018 se observa un caso de porno-extorsión hacia la periodista Rana Ayyub (Ayyub, R., 2018a; Ayyub, R., 2018b), acosada mediante un video porno deepfake, con el fin de hacerla callar por una denuncia política realizada, víctima de una campaña de desinformación y desprestigio en redes digitales. El mismo año, Jordan Peel publica You Won’t Believe What Obama Says In This Video! (Silverman, 2018) en BuzzFeed, inicia el género discursivo de denuncia en donde advierte los riesgos de desinformación que pueden generar los deepfakes (Silverman, 2018). La pieza de Peel retoma la idea original de un pionero del learning lip sync from audio en Synthezising Obama (2017) mediante Face2Face (Suwajanakorn et al., 2017a y 2017b) (Ajder et al., 2019).

En 2018 destaca el caso del mensaje de fin de año del presidente de Gabón Ali Bongo Ondimba (Gabon 24, 2018). Un discurso que pertenece al género de propaganda política y que fungió también como contrapropaganda. El video fue interpretado como deepfake por las fuerzas de oposición detonando un golpe de estado ante la creencia del fallecimiento del presidente. La oposición no pudo demostrar si se trataba de un deepfake, y el presidente apareció días más tarde en un acto público negando la falsedad del video.

En 2019 se advierte ya una ligera expansión de géneros discursivos del deepfake en expresiones relacionadas con arte (video performances IA Art), en las obras de Klingemann (Sotheby´s, 2019) quien construye una galería en Twitter con el hashtag #BigGAN. Inicia la producción de retratos vivientes o modelos de cabezas parlantes (talking heads) mediante tecnología de red neuronal convolucional impulsada por Samsung (Zakharov et al., 2019; Nield, 2020), un género que se expande en los retratos vivientes de Deepnostalgia de la app MyHeritage (2021).

Se fortalece el entretenimiento a través de la parodia como género discursivo, es el caso del trabajo realizado por Ctrl Shift Face, The Fakening, FaceToFake en YouTube, que producen deepfakes fusionando rostros de actores en escenas retomadas de obras cinematográficas y programas de televisión, como en Bill Hader channels Tom Cruise (Ctrl Shift Face, 2019), en donde se intercambia el rostro de Hader por el de Tom Cruise de manera intermitente durante una entrevista; o de Al Pacino y Schwarzenegger (2019). Ctrl Shift Face hace un trabajo experimental muy similar al realizado por Derpfakes, Shamook o Jarkan en YouTube, quienes desafían las técnicas usadas por la laboriosa producción de efectos visuales (CGI) de Light and Magic (Disney-StarWars), en la recreación de la Princiesa Leia (Carrie Fisher) (Derpfakes, 2018) y Grand Moff Tarkin (Peter Cushing) en Rouge One: A Star Wars Story (2016), entre otros ejemplos, como De-agingRobert Deniro in The Irishman (Shamook, 2020).

Los géneros discursivos de entretenimiento atraviesan y fusionan prácticas de la sátira y la parodia en memes deepfake virales como los de Obama sings Baka Mitai (Mechanical, 2020), Avengers (Moe Ment, 2020) y la extensa serie asociada a esta canción (Hao, 2020); o bien, en usos en videojuegos donde el usuario puede insertarse como avatar en tiempo real, como propone la plataforma Unreal Engine (2021) (Initiative, 2020); o con técnicas de facial re-enactment, speech synthesis, multi-player games, y performance capture (Gardiner, 2019; Zakharov et al., 2019; Jesso et al., 2020; Nield, 2020). También, emergen otros géneros de entretenimiento en deepfake, como el espectáculo de cabaret creado por The Zizi Show (2020); y las transmisiones deportivas realizadas con sistemas de inteligencia artificial como Pixellot.tv (2021).

En el género de ficción cinematográfica, Disney y otros estudios cinematográficos investigan técnicas de deep learning AI .High-resolution reural face swapping for visual effects) (Naruniec et al., 2020) para la creación de personajes, al estilo The Irishman (Scorsese, 2019) producidos todavía con efectos visuales (VFX) y gráficos generados por computadora (CGI) que obtuvo resultados cuestionables.

La emergencia de géneros de denuncia y arte desde 2019 aparece en proyectos como el de Bill Posters en Instagram denominado Spectre (Bill_posters_uk, 2019), en donde construye videos de denuncia política con celebridades y políticos como Mark Zuckerberg o Donald Trump para alertar sobre los riesgos de la desinformación.

Para 2021 las técnicas de doblaje y traducción han evolucionado en el campo cinematográfico con el deepfake. Un ejemplo es Flawless, un programa realizado con la técnica de neural style-Preserving visual dubbing, que permite hacer un doblaje en diversos idiomas sin perder los rasgos originales de los actores (Hyeongwoo et al., 2019; Vincent, 2021).

Entre 2020-2021 se encuentra como tendencia la mayor expansión de géneros discursivos con usos benéficos. Los usos del deepfake en géneros como el activismo político, campañas sociales y denuncia se han amplificado en este período. Como ejemplo, las campañas protagonizadas por David Beckham para combatir la malaria en donde habla nueve idiomas o declara el fin de la enfermedad con 70 años de edad (Malaria Most Die, 2019 y 2021). El género de activismo político se puede encontrar en el deepfake en el que el periodista mexicano Javier Valdez, asesinado en 2017, denuncia en 2020 la violencia y desaparición de informadores y exige justicia (Propuesta Cívica, 2020).

Un extenso campo semántico es el de la desinformación, a la que se suman géneros discursivos del deepfake mediante fake news. Casos como los videos fakes realizados con los presidentes Trump y Obama emitiendo declaraciones falsas relacionadas con la cumbre de Davos 2020 (CBS, 2020); y las declaraciones de los presidentes Kim y Putin (Greene, 2021) en la serie Dictators (RepresentUs, 2020a y 2020b) sobre la democracia norteamericana previo al proceso electoral de 2020. También destacan los casos de Boris Johnson y Jeremy Corbyn (Future Advocacy, 2019a y 2019b) donde emiten opiniones contrarias a sus idearios, o la Reina Isabel II grabando un video para TikTok en un mensaje de fin de año (Channel 4 Comedy, 2021).

Un caso de desinformación relevante en India es el del presidente Manoj Tiwari del Bharatiya Janata Party (BJP) quien envió un mensaje político electoral en diversos dialectos indios dirigido a 15 millones de ciudadanos, sin advertir que el video fue generado con IA y que él no habla esos dialectos (Jee, 2019; Lyons, 2020). Estos casos ponen de manifiesto la delgada línea entre información y desinformación, a pesar de contar, algunos de ellos, con la advertencia de ser deepfakes (Chawla, 2019; Forsdick, 2019).

En 2021, proliferan los géneros discursivos en el campo del marketing, comercio electrónico, moda y venta minorista (retail). Como las aplicaciones Superpersonal App (2021), Amazon Style Snap (2020), Google Lens (2021), que permiten a los clientes probarse vestuarios virtuales, cambiar su rostro por modelos digitales y realizar compras en línea. Para tiendas minoristas de ropa y moda es una oportunidad de crear o convertir a sus clientes en modelos virtuales personalizados con poco presupuesto de marketing (Campbell et al., 2021, Zeynal et al., 2021).

La Covid-19 aceleró la adopción de avatares y ambientes digitales en el comercio minorista y la moda, es el caso de Balmain (Balmain, 2020; Digital, 2020) al presentar la “colección Zoom”, con un avatar de su diseñador Olver Rousteing (Socha, 2020). Usos, aplicaciones y géneros discursivos asociados a la publicidad, el marketing, la moda como Echo Look, incluida en Shopping App de Amazon o como Generated Photos (2021) transforman la industria de la moda y el turismo utilizando avatares, mapeo facial, plataformas foto-reales inmersivas y modelos de generación IA (Bogicevic et al., 2019; Whittaker et al., 2021; Dietmar, 2019).

Los géneros discursivos relacionados con humanos digitales y asistentes inteligentes también están en expansión. Los asistentes inteligentes se asocian a usos en telepresencia, videoconferencias, chatbots y creación de personajes para ficción cinematográfica. Es el caso de los humanos digitales producidos por Doug Roble (Roble et al., 2019) mediante captura de movimiento inercial (inertial motion capture) y redes neuronales (deep neural networks) (Ted, 2019); y el asistente virtual Google Duplex (Huffman, 2018; Leviathan, 2018).

Aparecen igualmente los primeros usos de deepfakes para anuncios publicitarios como el de Soriana (2021) Cantinflas, un famoso actor de cine fallecido en 1993 protagoniza el primer anuncio deepfake en México para un supermercado (Ferrer, 2021). A esto se unen una avalancha de avatares e influencers producidos por IA que irrumpen en el campo de la publicidad y las redes sociales como Lil Miquela (2021), Colonel Sanders (KFC, 2021; Digital Agency Network, 2020), Mona Haddid (2021), Shudu (2021), Bermunda (2021), Blawko (2021) e Imma (2021) (Guthrie, 2020; Mosley, 2021; Adriani, 2019).

En el campo de la educación se encuentran aplicaciones como las recreaciones de Dalí Lives en The Dalí Museum (2019), Digital Einstein (2021) o Dimension in Testimony (University of Southern California's Shoah Foundation, 2021), recursos educativos con los que se puede entablar una conversación interactiva y conocer más sobre la vida y obra de estos autores, o de los sobrevivientes del Holocausto.

Los discursos del deepfake comparten las características de la cultura sociomediática digital, la cultura post-meme y la cultura mediática snack, compuestas por narrativas breves, transmedia, hipermedia, intertextuales, compartidas en redes sociales y plataformas digitales como Facebook, Twitter, WhatsApp, TikTok e Instagram, entre otras (Scolari, 2020; Bown y Briston, 2019).

Un deepfake es susceptible de participar de las formas y comportamientos de otras especies mediáticas como el meme, gif, selfies, avatares, imágenes rumorales, fotomontajes animados, mockumentality, videomontajes, videos cortos, micropiezas narrativas (sátiras, parodias, finales alternativos, falsos tráileres, etc.), micro-formatos informativos, propagandísticos, pots, tráileres, teasers, videoclips, lipdubs, webisodios, sneak-peeks, mobisodios, credits, nanorrelatos, nanocontenidos, entre otros formatos de microficción o microficción documental propios (Scolari, 2020; Aldrin, 2005; Cortazar, 2014; Conte, 2019).

Discusión

Progresivamente asistimos a una expansión de campos semánticos y géneros discursivos del deepfake, que reconfiguran el escenario que apareció inicialmente en 2017, y que hacia 2021 presenta nuevos horizontes con una marcada tendencia al desarrollo de aplicaciones benéficas en diversas esferas económicas, culturales y mediáticas.

A pesar de que los usos delictivos persisten, como la pornografía, el acoso, la extorsión, la suplantación de identidad, las fake news y la desinformación, la producción deepfake comienza a experimentar una tendencia hacia usos benéficos que se observa en géneros como el activismo político, campañas sociales, educación, salud, comercio electrónico, marketing, publicidad, moda, turismo, espectáculos, asistentes virtuales, video juegos y ficción cinematográfica.

Esta tendencia exige una resignificación del término deepfake, que hasta ahora había sido empleado para catalogar todo documento audiovisual producido mediante técnicas de deep learning, GAN´s, redes neuronales convolucionales y otras técnicas de IA. Actualmente, se debate si el término deepfake debería ser usado exclusivamente para denominar prácticas delictivas, y synthetic media para los usos benéficos (Schick, 2020, Barnes y Barraclough, 2020).

La catalogación realizada en las figuras 1 y 2 retoma los datos más relevantes del conjunto de la investigación bibliográfica y documental, aunque no es producto de un método cuantitativo, sino cualitativo e interpretativo, lo que puede ser entendido como una limitación del estudio.

El deepfake, como objeto tecno-estético, se encuentra en una etapa de resignificación en cuanto a sus campos semánticos y géneros discursivos. Este proceso se realiza en un escenario tecnológico y mediático altamente dinámico y cambiante en el que se expanden progresivamente sus usos y prácticas culturales.

Referencias

Adriani, R. (2019). The Evolution of Fake News and the Abuse of Emerging Technologies. European Journal of Social Sciences, 2(1), 32-38. https://bit.ly/3svE2JE

Ajder, H., Patrini, G., y Cavalli, F. (2020). Automating image abuse: Deepfake bots on Telegram. Sensity. https://bit.ly/3poYgTG

Ajder, H., Patrini, G., Cavalli, F. (2019). The State of Deepfakes: Landscape, Threats, and Impact. Deeptrace. https://bit.ly/3suHfJB

Aldrin, P. (2005). Sociologie politique des rumeurs. Presses Universitaires de France (PUF)

Amazon (2020). Stylesnap. https://amzn.to/3tlsUhD

Amorós, M. (2019). Fake News, la verdad de las noticias falsas. Plataforma Editorial.

Ayyub, R. (21 de noviembre de 2018a). I Was The Victim Of A Deepfake Porn Plot Intended To Silence Me. HuffPost UK. https://bit.ly/3C1nmwO

Ayyub, R. (22 de mayo de 2018b). Opinion | In India, Journalists Face Slut-Shaming and Rape Threats. The New York Times. https://nyti.ms/3stcjtc

Baethge, C., Goldbeck-Wood, S., y Mertens, S. (2019). SANRA—a scale for the quality assessment of narrative review articles. Research integrity and peer review, 4(1), 1-7. https://doi.org/10.1186/s41073-019-0064-8

Ball, J. (2017). Post-Truth: How Bullshit Conquered the World. Bite Back Publishing.

Balmain [@balmain] (15 de junio de 2020). Balmain [Video]. Instagram. https://bit.ly/3K5T8f4

Bañuelos, J. (2022). Fig. 3. Inventario de artículos analizados utilizando la metodología de la Escala SANRA - Scale for the Assessment of Narrative Review Articles (Baethge, C., Goldbeck-Wood, S., y Mertens, S., 2019). https://figshare.com/s/07888bce696bfe90939c

Barnes, C. y Barraclough, T. (2019). Perception inception: Preparing for deepfakes and the synthetic media of tomorrow. The Law Foundation.

Barnes, C., y Barraclough, T. (2020). Deepfakes and synthetic media. In Emerging technologies and international security (pp. 206-220). Routledge.

Bermuda [@bermudaisbae]. (28 de junio de 2021). Bermuda [Instagram profile]. Instagram. https://bit.ly/3MbRpGM

bill_posters_uk (7 de junio de 2019). Spectre. [Video]. Instagram. https://bit.ly/3C59QZ9

Blawko [@blawko22]. (28 de junio de 2021). Blawko [Instagram profile]. Instagram. https://bit.ly/3IyF9y1

Bogicevic, V., Seo, S., Kandampully, J. A., Liu, S. Q., y Rudd, N. A. (2019). Virtual reality presence as a preamble of tourism experience: The role of mental imagery. Tourism Management, 74, 55-64. https://doi.org/10.1016/j.tourman.2019.02.009

Bown, A. y Briston, D. (2019). Post Memes: Seizing the Memes of Production. Punctum books. https://doi.org/10.2307/j.ctv11hptdx

Campbell, C., Plangger, K., Sands S y Kietzmann, J. (2021). Preparing for an era of deepfakes and AI-generated ads: A framework for understanding responses to manipulated advertising. Journal of Advertising. https://doi.org/10.1080/00913367.2021.1909515

CBS (24 de enero de 2020). President’s words used to create “deepfakes” at Davos. [Video]. YouTube. https://bit.ly/3poo9Tq

Cerdán, V., García Guardia, M. L., Padilla, G. (2020). Alfabetización moral digital para la detección de deepfakes y fakes audiovisuales. CIC: Cuadernos de información y comunicación, 25, 165-181. http://dx.doi.org/10.5209/ciyc.68762

Codina, Ll. (2018). Revisiones bibliográficas sistematizadas: Procedimientos generales y framework para Ciencias Humanas y Sociales. En C. Lopezosa; J. Díaz-Noci, J.; Ll. Codina, Methodos. Anuario de métodos de investigación en comunicación social. Universitat Pompeu Fabra, (50-60). https://doi.org/10.31009/methodos.2020.i01.05

Cole, S. (27 junio 2019). Esta terrorífica app crea un nude de cualquier mujer con un simple clic. Vice. https://bit.ly/3M9LvpE

Conte, P.J. (2019). Mockumentality: from hyperfaces to deepfakes. World Literature Studies. Insitute of World Literature SAS. https://bit.ly/3K1aTfe

Cosentino, G. (2020). Social Media and the Post-Truth World Order. The Global Dynamics of Disinformation. Springer Nature.

Cooke, N. A. (2018). Fake News and Alternative Facts. Information Literacy in a Post-Truth Era. American Library Association.

Cortazar Rodríguez, F. J. (2014). Imágenes rumorales, memes y selfies: elementos comunes y significados. Iztapalapa. Revista de ciencias sociales y humanidades, 35(77), 191-214. https://doi.org/10.28928/ri/772014/aot3/cortazarrodriguezfj

Channel 4 Comedy (15 de marzo de 2021). The Queen’s Christmas message gets a deepfake makeover. [Video]. YouTube. https://bit.ly/35H7UtO

Chawla, R. (2019). Deepfakes: How a pervert shook the world. International Journal for Advance Research and Development, 4, 4-8. https://bit.ly/3psxedZ

Chen, M., Radford, A., Child, R., Wu, J., Jun, H., Luan, D., Sutskever, I. (2020). Generative pretraining from pixels. En: Proceedings of the 37th International conference on machine learning, n. 119, 1691-1703. https://bit.ly/3hLcTwp

Ctrl Shift Face (6 de agosto, 2019). Bill Hader channels Tom Cruise [DeepFake]. [Video]. YouTube. https://www.youtube.com/watch?v=VWrhRBb-1Ig

D´Ancona, M. (2018). Post-Truth, the New War on Truth and How to Fight Back. Edbury Press.

Digital, K. (28 de diciembre de 2020). Balmain Virtual Showroom [Video]. Vimeo. https://vimeo.com/498685433

Google Lens (2021)- Search What You See. (2021, November 19). Google Lens. https://lens.google/

Granda-Orive, J. I., Alonso-Arroyo, A., García-Río, F., Solano-Reina, S., Jiménez-Ruiz, C. A., y Aleixandre-Benavent, R. (2013). Ciertas ventajas de Scopus sobre Web of Science en un análisis bibliométrico sobre tabaquismo. Revista española de documentación científica, 36(2), e011-e011. https://doi.org/10.3989/redc.2013.2.941

Derpfakes (7 de septimebre de 2018). Princess Leia Remastered...Again [Video]. YouTube. https://bit.ly/3tmQaMe

Dietmar, J. (2019, May 21). GANs And Deepfakes Could Revolutionize The Fashion Industry. Forbes. https://bit.ly/3pop32g

Digital Agency Network (19 de noviembre de 2020). Meet KFC’s New Computer-Generated Virtual-Influencer, Colonel. Digital Agency Network. https://bit.ly/3IyHE3n

Ferrer (7 de mayo de 2021) Making of Cantinflas. Facebook. https://bit.ly/35j9amY

Forsdick, S. (2019, February 27). Meet the team working to prevent the spread of next-gen fake news through ‘deepfake’ videos. NSBusiness. https://bit.ly/3vuivmO

Fraga-Lamas, P., y Fernández-Caramés, T. M. (2020). Fake news, disinformation, and deepfakes: Leveraging distributed ledger technologies and blockchain to combat digital deception and counterfeit reality. IT Professional, 22(2), 53-59. https://doi.org/10.1109/MITP.2020.2977589

Future Advocacy (26 de noviembre de 2019a). Boris Johnson has a message for you. (deepfake). [Video]. YouTube. https://bit.ly/3swIbNt

Future Advocacy (26 de noviembre de 2019b). Jeremy Corbyn has a message for you. (deepfake). [Video]. YouTube. https://bit.ly/3MdPNMH

Gabon 24 (31 de diciembre de 2018). Discours à la nation du président ali bongo ondimba. [Video]. Facebook. https://bit.ly/3K7LZL0

Garimella, K. y Eckles, D. (2020). Images and misinformation in political groups: Evidence from WhatsApp in India. https://doi.org/10.37016/mr-2020-030

Generated Photos (28 de junio de 2021). Gallery of AI Generated Faces | Generated.photos. (n.d.). https://generated.photos/faces

Gómez-de-Ágreda, Á., Feijóo, C., y Salazar-García, I. A. (2021). Una nueva taxonomía del uso de la imagen en la conformación interesada del relato digital. Deep fakes e inteligencia artificial. Profesional de la Información, 30(2). https://doi.org/10.3145/epi.2021.mar.16

Gosse, Ch. y Burkell, J. (2020). Politics and porn: how news media characterizes problems presented by deepfakes. Critical Studies in Media Communication. FIMS Publications. 345. https://ir.lib.uwo.ca/fimspub/345

Greene, T. (2021, September 30). Who thought political ads featuring Deepfake Putin and Kim trashing the US was a good idea? Tnw. https://bit.ly/3Mbdrtb

Guthrie, S. (2020). Virtual influencers: More human than humans. In Influencer Marketing (pp. 271-285). Routledge. https://bit.ly/3HzglVg

Güera, D. y Delp, E. J. (2018). Deepfake video detection using recurrent neural networks. In 2018 15th IEEE international conference on advanced video and signal based surveillance (AVSS) (pp. 1-6). IEEE. https://doi.org/10.1109/AVSS.2018.8639163

Hao, K. (3 de septiembre de 2020). 'Deepfakes' virales: la fina línea que separa el humor del abuso. MIT Technology Review. https://bit.ly/3pt6oCu

Hao, K. (20 de octubre de 2020). A deepfake bot is being used to “undress” underage girls. MIT Technology Review. https://bit.ly/3ps0ql8

Huffman, S. (8 de mayo de 2018). The future of the Google Assistant: Helping you get things done to give you time back. The Keyword. https://bit.ly/3pszySf

Ibañez, J. (2017). En la era de la posverdad. Calambur.

Imma [@imma.gram]. (28 de junio de 2021). Imma.gram [Instagram profile]. Instagram. https://bit.ly/344cWzX

Initiative (2020). Culture Shock. True, Lies and Technology. https://bit.ly/35HaeRy

Ipsen, G. (1924). Der alte Orient und die Indogermanen. Festschrif - W. Streitberg. Heidelberg, 200-237.

Jee, Ch. (2019). An Indian politician is using deepfake technology to win new voters. MIT Technology Review. https://bit.ly/3IBsdat

Kalpokas, I. (2019). A Political Theory of Post-Truth. Palgrave Macmillan.

KFC (23 de julio de 2021). KFC/WTF! Deep Fake Colonel Sanders. [Video]. YouTube. https://bit.ly/35gc7ou

Kietzmann, J., Lee, L. W., McCarthy, I. P., Kietzmann, T. C. (2020). Deepfakes: Trick or treat? Business Horizons, 63(2), 135–146. https://doi.org/10.1016/j.bushor.2019.11.006

Kwok, A. O., y Koh, S. G. (2020). Deepfake: a social construction of technology perspective. Current Issues in Tourism, 24(13), 1798-1802. https://doi.org/10.1080/13683500.2020.1738357

Hyeongwoo, K. et. al. (2019). Neural style-Preserving visual dubbing. SIGGRAPH Asia 2019. https://bit.ly/3tjRdwH

Leviathan, Y. (2018, May 08). Google Duplex: An AI System for Accomplishing Real-World Tasks Over the Phone. Google AI Blog. https://bit.ly/3vBLZyO

Lil Miquela (2021). [@lilmiquela]. LilMiquela [Instagram profile]. Instagram. Recuperado junio 28, 2021. https://bit.ly/3vuQ4Vt

Lyons, K. (2020, Feb 18). An Indian politician used AI to translate his speech into other languages to reach more voters. The Verge. https://bit.ly/35lz1L1

Malaria Most Die (2019). David Beckham speaks nine languages to launch Malaria Must Die Voice Petition. [Video]. YouTube. https://bit.ly/343XqUT

Malaria Most Die (2021). A World Without Malaria. https://bit.ly/3sthARw

Maras, M. H. y Alexandrou, A. (2018). Determining authenticity of video evidence in the age of artificial intelligence and in the wake of Deepfake videos. The International Journal of Evidence .Proof, 23(3), 255–262. https://doi.org/10.1177/1365712718807226

Martínez, M. (2003). Definiciones del concepto campo en Semántica: antes y después de la lexemática de E. Coseriu. Odisea No. 3. Universidad Complutense de Madrid. http://repositorio.ual.es/handle/10835/1380

Martínez, V. C. y Castillo, G. P. (2019). Historia del" fake" audiovisual:" deepfake" y la mujer en un imaginario falsificado y perverso. Historia y Comunicación Social, 24(2), 55. https://doi.org/10.5209/hics.66293

Mechanical (Julio 26, 2020). obamasings baka mitai. [Video]. YouTube. https://bit.ly/3suHg08

Meersohn, C. (2021). Introducción a Teun Van Dijk: Análisis de Discurso. Cinta de Moebius. Facultad de Ciencas Sociales, Universidad de Chile.

Moe Ment (6 de agosto de 2020). Avengers: Dame Da Ne (Baka Mitai) [Video]. YouTube. https://bit.ly/3IAzuaH

Mona Haddid [@monna_haddid]. (28 de junio de 2021) Mona Haddid [Instagram profile]. Instagram. https://bit.ly/35ZDxM4

Mosley, M. (2021). Virtual Influencers: What Are They & How Do They Work? Influencer Matchmaker. https://bit.ly/3hsMiDV

Naruniec, J., Helminger, L., Schroers, C., y Weber, R. M. (2020). High‐resolution neural face swapping for visual effects. In Computer Graphics Forum (Vol. 39, No. 4, pp. 173-184). https://onlinelibrary.wiley.com/doi/abs/10.1111/cgf.14062

Nield, D. (2020). Samsung's Creepy New AI Can Generate Talking Deepfakes From a Single Image. Science Alert. https://bit.ly/3hvhyCg

Nguyen, T. T., Nguyen, C. M., Nguyen, D. T., Nguyen, D. T., y Nahavandi, S. (2019). Deep learning for deepfakes creation and detection: A survey. Cronell University. http://arxiv.org/abs/1909.11573

Oliveira-Teixeira, F., Donadon-Homem, T. P., y Pereira-Junior, A. (2021). Aplicación de inteligencia artificial para monitorear el uso de mascarillas de protección. Revista Científica General José María Córdova, 19(33), 205-222. https://doi.org/10.21830/19006586.725

Paris, B. y Donovan, J. (2019). Deepfakes and Cheap Fakes. United States of America: Data y Society. https://bit.ly/3pP6VPx

Parkinson, H. (8 de octubre de 2016). Presidential Avengers: Uncivil War. [Video]. YouTube. https://bit.ly/3ps0Msg

Piasecki, J., Waligora, M., y Dranseika, V. (2018). Google search as an additional source in systematic reviews. Science and engineering ethics, 24(2), 809-810. https://doi.org/10.1007/s11948-017-0010-4

Pixellot.tv. T. (22 de diciembre de 2021). AI-Automated Sports Camera, Streaming & Analytics. https://bit.ly/3IpL9IZ

Propuesta cívica. (29 de octubre de 2020). Iniciativa #SeguimosHablando exige justicia para periodistas asesinados y desaparecidos en México. [Video]. YouTube. https://bit.ly/3K4y74n

RepresentUs (29 de septiembre de 2020a). Dictators - Vladimir Putin. [Video]. YouTube. https://bit.ly/3HA2Vs1

RepresentUs (29 de septiembre de 2020b). Dictators- Kim Jong-Un. [Video]. YouTube. https://bit.ly/3trzZ0u

Roble, D., Hendler, D., Buttell, J., Cell, M., Briggs, J., Reddick, C. y Chien, C. (2019). Real-time, single camera, digital human development. ACM SIGGRAPH 2019 Real-Time Live! (pp. 1-1). https://doi.org/10.1145/3306305.3332366

Rodríguez Jiménez, A., & Pérez Jacinto, A. O. (2017). Métodos científicos de indagación y de construcción del conocimiento. Revista Escuela De Administración De Negocios, (82), 175–195.

Scolari, C. (2020). Cultura snack. La Marca.

Schick, N. (2020). Deepfakes: The Coming Infocalypse. Hachette.

Simondon, G. (2013). Imaginación e invención. Editorial Cactus.

Socha, M. (2020). Exclusive: Olivier Rousteing’s Avatar Greets Buyers at Balmain’s Virtual Showroom. WWD. https://bit.ly/3svTwxi

Sohrawardi, S. J., Chintha, A., Thai, B., Seng, S., Hickerson, A., Ptucha, R., y Wright, M. (Noviembre, 2019). Poster: Towards robust open-world detection of deepfakes. In Proceedings of the 2019 ACM SIGSAC Conference on Computer and Communications Security (pp. 2613-2615). https://doi.org/10.1145/3319535.3363269

Shamook (19 de agosto de 2020). De-aging Robert Deniro in The Irishman [DeepFake]. (2020, August 19). [Video]. YouTube. https://www.youtube.com/watch?v=dHSTWepkp_M

Shudu [@shadu.gram]. (28 de junio de 2021).Shadu [Instagram profile]. Instagram. https://bit.ly/35e1vqc

Silverman, C. (Abril 17, 2018). How To Spot A Deepfake Like The Barack Obama–Jordan Peele Video. BuzzFeed. https://bzfd.it/3tkHzd1

Soriana (2021). Cantinflas. (Mayo 1, 2021). [Video]. YouTube. https://bit.ly/342gP8u

Sotheby´s (2019). Artificial Intelligence and the Art of Mario Klingemann. Sotheby´s. https://bit.ly/3HCg6sq

Superpersonal - Personalised styling and virtual fitting room. (Septiembre 9, 2021). Product Hunt. https://bit.ly/3stuXkG

Suwajanakorn, S., Seitz, S. M. y Kemelmacher-Shlizerman, I. (2017a). Synthesizing obama: learning lip sync from audio. ACM Transactions on Graphics (ToG), 36(4), 1-13. https://bit.ly/3huNLd0

Suwajanakorn, S., Seitz, S. M., y Kemelmacher-Shlizerman, I. (Julio 12, 2017b). Synthesizing Obama: Learning Lip Sync from Audio. [Video]. YouTube. https://bit.ly/3C1QBzL

Ted (Mayo 28, 2019). Digital humans that look just like us | Doug Roble. [Video]. YouTube. https://bit.ly/3HvQehJ

Temir, E . (2020). Deepfake: New Era in The Age of Disinformation y End of Reliable Journalism. Selçuk İletişim, 13 (2), 1009-1024. http://dx.doi.org/10.18094/JOSC.685338

The Dalí Museum. Behind the Scenes: Dalí Lives. (8 de mayo de 2019). [Video]. YouTube. https://bit.ly/35oHvAZ

The Zizi Show (2020) - A Deepfake Drag Cabaret. (n.d.). The Zizi Show. https://zizi.ai/

University of Southern California's Shoah Foundation (2021). Dimension of Testimony. https://sfi.usc.edu/dit

Unreal Engine (2021). Unreal Engine The most powerful real-time 3D creation tool. (2021, November 25). https://www.unrealengine.com/en-US/

Vaccari, C. y Chadwick, A. Deepfakes and Disinformation: Exploring the Impact of Synthetic Political Video on Deception, Uncertainty, and Trust in News. Social Media + Society. January-March 2020: 1–13.

Vincent, J. (2021, May 18). Deepfake dubs could help translate film and TV without losing an actor’s original performance. The Verge. https://bit.ly/3IxFkcP

Westerlund, M. (2019). The Emergence of Deepfake Technology: A Review. Technology Innovation Management Review. https://timreview.ca/article/1282

Whittaker, L., Letheren, K. y Mulcahy, R. (2021). The Rise of Deepfakes: A Conceptual Framework and Research Agenda for Marketing. Australasian Marketing Journal, 29(3), 204-214. https://doi.org/10.1177/1839334921999479

Zakharov, E., Shysheya, A., Burkov, E., y Lempitsky, V. (2019). Few-shot adversarial learning of realistic neural talking head models. In Proceedings of the IEEE/CVF International Conference on Computer Vision (pp. 9459-9468), https://arxiv.org/abs/1905.08233

Xu, B., Liu, J., Liang, J., Lu, W. y Zhang, Y. (2021). DeepFake Videos Detection Based on Texture Features. Computers, Materials . Continua, 68(1), 1375–1388. https://doi.org/10.32604/cmc.2021.016760

Zeynal, O., Malekzadeh, S. (2021). Virtual Dress Swap Using Landmark Detection. arXiv.org. https://arxiv.org/abs/2103.09475

Notas

2

Las publicaciones sobre deepfake aumentan progresivamente, tanto las informales, las periodísticas y las científicas. El buscador Google Search arroja 19,200,000 resultados (1 de mayo 2021); en 2020 aparecían 1301 publicaciones académicas sobre GAN´s en arXiv (Cornel University), y para mayo de 2021 ya existen 4092 artículos con especialidad en matemáticas sobre el tema. En Web of Science, la búsqueda para deepfake arrojó 81 publicaciones (1 mayo 2021) de los cuales 65 corresponden a áreas de Ciencias de la Computación e Ingeniería, 11 para Comunicación, 5 para Derecho, 2 para film, radio, televisión, 2 para Ciencia Política, 2 para Ética. En Socpus aparecen 603 artículos sobre deepfake entre 2018 y 2021, de los cuales 447 están relacionados con el campo de las Ciencias Computacionales, 224 con Ingeniería, 166 con Ciencias Sociales, 74 cn Matemáticas, 68 con Ciencias para la Toma de Decisiones, 39 con Arte y Humanidades, 36 con Material Científico, 31 con Física y Astronomía, 29 con Psicología, 24 con Negocios, Gestión y Contabilidad. Como se puede observar, el campo de investigación sobre deepfake está mucho más desarrollado en el área de Ciencias Computacionales e Ingeniería, respecto a Ciencias Sociales. Google Scholar arrojó 4,270 resultados para la búsqueda de “deepfake”, 639 para “deepfake” and “discourse” y 141 para “deepfake” y “discurso”. En Taylor and Francis Journals aparecen 80 artículos científicos con la búsqueda “deepfake”, entre los más numerosos encontramos 30 de Humanidades, 26 de derecho, 23 de Ciencias Sociales, 9 de Comunicación, en donde los temas centrales son Desinformación, Pornografía, Política, Publicidad, Seguridad. Para la búsqueda “deepfake” and “dicourse” encontramos 35 artículos que versan principalmente sobre estos mismos campos semánticos. El perfil de cada revista condiciona sin duda el tipo de especialidad con el que se relacionan los artículos publicados.

Notas de autor

1 Director de la Maestría en Comunicación (Departamento de Estudios Culturales del Tecnológico de Monterrey), México.

Información adicional

Para citar este artículo

:

Bañuelos, J. (2022). Evolución del Deepfake: campos semánticos y géneros discursivos (2017-2021). Revista ICONO 14. Revista Científica De Comunicación Y Tecnologías Emergentes, 20(1). https://doi.org/10.7195/ri14.v20i1.1773

ISSN: 1697-8293

Vol. 20

Num. 1

Año. 2022

Evolución del Deepfake: campos semánticos y géneros discursivos (2017-2021)

Jabob Bañuelos